Un estudio académico reveló diferencias en el rendimiento del reconocimiento facial según variables étnicas y de género. La medida reactiva el debate sobre la fiabilidad, la equidad y el marco regulatorio del uso de inteligencia artificial en seguridad pública.

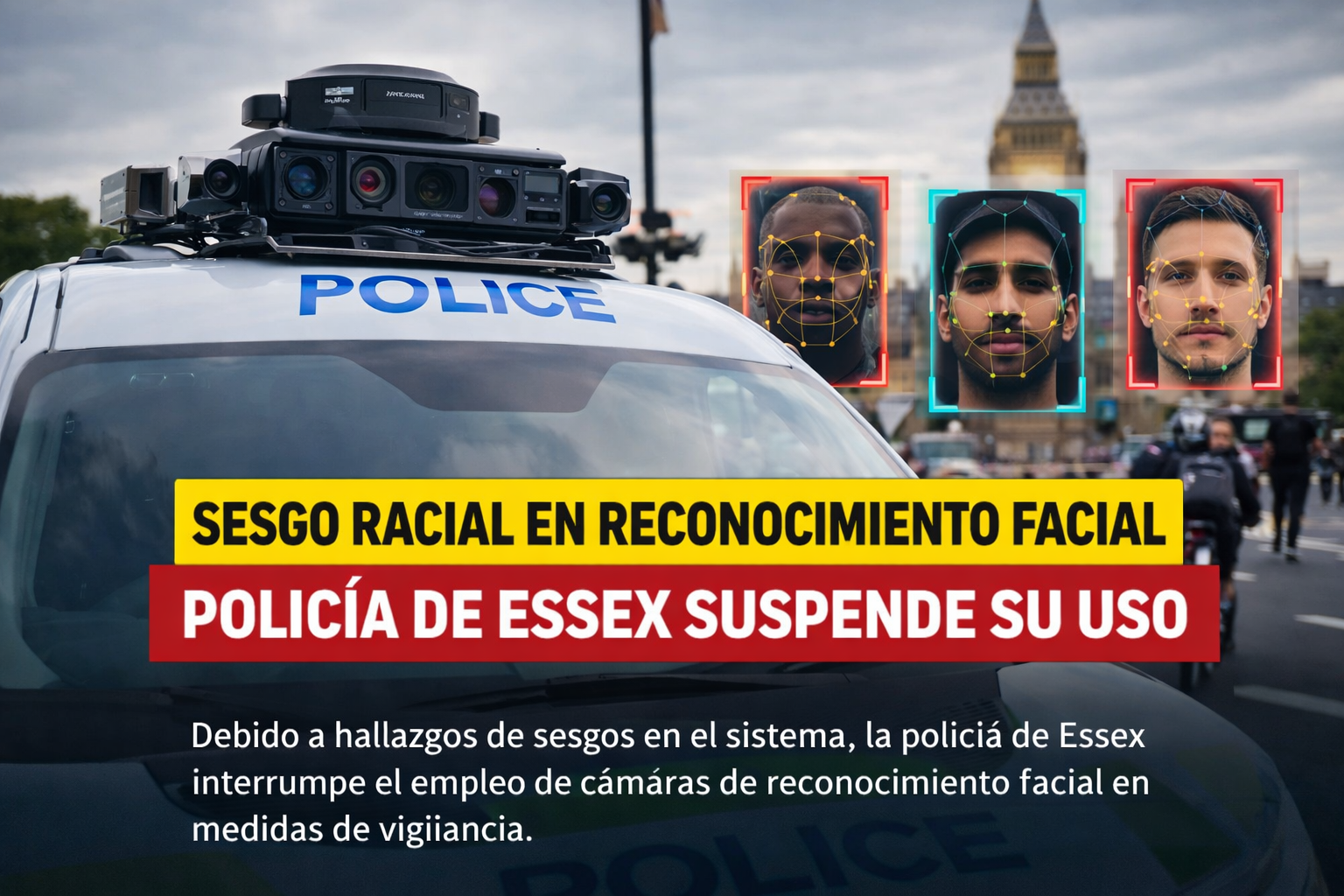

La policía del condado de Essex, en el Reino Unido, suspendió el uso de sistemas de reconocimiento facial en tiempo real (LFR, por sus siglas en inglés) luego de que un estudio independiente identificara posibles sesgos en su funcionamiento. La decisión fue comunicada por la Oficina del Comisionado de Información (ICO), organismo encargado de supervisar el uso de tecnologías de datos y privacidad.

El informe, elaborado por académicos de la Universidad de Cambridge, analizó el desempeño del sistema en un entorno controlado con 188 participantes. Los resultados indicaron que aproximadamente la mitad de las personas incluidas en listas de vigilancia fueron identificadas correctamente, mientras que los errores de identificación fueron poco frecuentes. Sin embargo, el estudio detectó diferencias relevantes: el sistema mostró mayor eficacia en la identificación de hombres respecto de mujeres y una probabilidad significativamente superior de reconocer a personas negras en comparación con otros grupos étnicos.

Según los investigadores, este hallazgo plantea interrogantes sobre la equidad del sistema y justifica un seguimiento más exhaustivo. En particular, se advierte que la mayor tasa de identificación en determinados grupos podría implicar un riesgo de impacto desproporcionado en contextos operativos reales.

La tecnología de reconocimiento facial en tiempo real se despliega mediante cámaras instaladas en puntos fijos o en unidades móviles policiales. Su utilización se ha expandido en distintas regiones del Reino Unido, donde al menos 13 fuerzas policiales han implementado estos sistemas. A nivel gubernamental, el Ministerio del Interior había anunciado recientemente la ampliación del número de unidades móviles disponibles, lo que evidencia una estrategia de intensificación en el uso de estas herramientas.

No obstante, el caso de Essex introduce un elemento de cautela. La ICO advirtió sobre posibles riesgos de inexactitud y sesgo, e instó a otras fuerzas a adoptar medidas de mitigación antes de continuar con su despliegue.

El debate sobre el reconocimiento facial suele centrarse en la posibilidad de identificaciones erróneas de personas inocentes. Sin embargo, el estudio reciente introduce una dimensión distinta: no solo se trata de errores, sino de diferencias en la precisión del sistema según características demográficas. Entre las hipótesis técnicas, se menciona la posibilidad de que los algoritmos hayan sido entrenados de manera no equilibrada, lo que podría influir en su rendimiento.

Pese a estas preocupaciones, las autoridades destacan que esta tecnología ha contribuido a la detención de personas buscadas por delitos graves en otras jurisdicciones. Sin embargo, organizaciones especializadas en derechos civiles advierten que el uso de inteligencia artificial en vigilancia requiere estándares estrictos de transparencia, control y validación independiente.

La suspensión en Essex se inscribe así en un contexto más amplio de revisión del uso de sistemas automatizados en el ámbito policial. El equilibrio entre eficacia operativa, garantías jurídicas y protección de derechos fundamentales se consolida como uno de los principales desafíos en la incorporación de inteligencia artificial a la seguridad pública.